Los resultados de búsqueda generados por inteligencia artificial de Google generan decenas de millones de respuestas inexactas por hora, incluso cuando el gigante tecnológico desvía visitantes e ingresos publicitarios de medios de comunicación con problemas de liquidez, según muestra un análisis explosivo.

Para probar la precisión de los conocimientos de inteligencia artificial de Google, la startup Oumi examinó 4.326 resultados de búsqueda de Google generados por el modelo Gemini 2 de Google y la misma cantidad de resultados generados por su modelo Gemini 3 más avanzado.

El análisis reveló que los modelos fueron precisos el 85% y el 91% de las veces, respectivamente.

Dado que se espera que Google procese más de 5 billones de buscadores solo en 2026, eso significa que los conocimientos de IA están generando noticias falsas a un ritmo de cientos de miles de errores por minuto, sin que los usuarios queden al tanto.

El New York Times fue el primero en Informe de análisis de Oumi.

“Los conocimientos de inteligencia artificial de Google han sido un desastre para los editores que dependen de los clics para financiar la producción de periodismo de calidad, pero también han fallado a los usuarios que buscan información precisa”, dijo Danielle Coffey, presidenta y directora ejecutiva de News/Media Alliance, un grupo comercial que representa a más de 2.000 medios de comunicación, incluido The Post.

Las respuestas incorrectas incluyeron varios errores básicos, como un error en el año en que la casa del músico Bob Marley se convirtió en un museo, un error en el año en que murió el ex lanzador de relevo de la MLB Dick Drago y la afirmación de que no había registro de que Yo-Yo Ma fuera incluido en el Salón de la Fama de la Música Clásica a pesar de que fue incluido en 2007, según los ejemplos que Oumi proporcionó al Times.

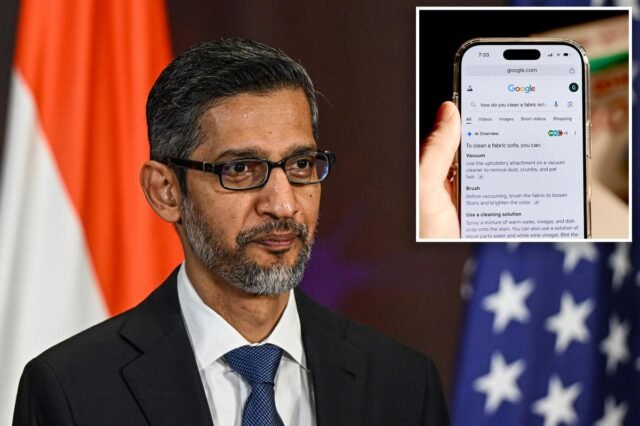

Las vistas previas de IA aparecen en la parte superior de los resultados de búsqueda de Google desde 2024, mientras que el conjunto tradicional de enlaces de medios azules están efectivamente ocultos, fuera de la vista. Los editores han acusado durante mucho tiempo a Google, liderado por el director ejecutivo Sundar Pichai, de robar su trabajo para “entrenar” su modelo de inteligencia artificial sin crédito ni compensación adecuada.

“Las respuestas generadas por algoritmos que extraen datos de casi todas las fuentes de Internet simplemente no son confiables”, dijo Coffey.

“Los editores gastan enormes cantidades de tiempo y dinero en garantizar que el contenido que ofrecen a sus lectores esté debidamente verificado, mientras que las vistas previas de la IA de Google se producen sin supervisión ni responsabilidad”.

AI Overviews también tiende a citar información de fuentes dudosas o fácilmente modificables, como páginas de Facebook, publicaciones de blogs y entradas de Wikipedia, como si fuera un hecho.

La función parece fácil de engañar para difundir noticias falsas.

El Times citó un ejemplo en el que el presentador de podcasts de la BBC, Thomas Germain, escribió una publicación en un blog proclamándose uno de “Los mejores periodistas tecnológicos por comer hot dogs”.

Los resúmenes de inteligencia artificial de Google habían engullido las noticias en un día y comenzaron a afirmar que Germain había “ganado notoriedad gracias a su destreza en la ‘división de noticias’ de las competencias gastronómicas”.

El análisis de Oumi se realizó entre octubre y febrero y utilizó una conocida prueba de referencia llamada SimpleQA, desarrollada por OpenAI y utilizada para evaluar la precisión de los modelos de IA.

Si bien la precisión mejoró en el salto entre Gemini 2 y Gemini 3, la investigación de Oumi mostró que los conocimientos de la IA se deterioraron al citar correctamente dónde encontró la información.

El porcentaje de respuestas a resúmenes de IA que eran “sin fundamento” o en las que los enlaces proporcionados por Google no respaldaban la información incluida en el resumen de IA, aumentó del 37% en Gemini 2 al 51% en Gemini 3, según el informe.

Un portavoz de Google dijo que el estudio de Oumi tenía “fallos graves”, en parte porque el punto de referencia SimpleQA incluye información inexacta en su propio conjunto de datos.

La compañía también cuestionó la confianza de Oumi en su propio modelo interno de IA, denominado HallOumi, para realizar el análisis, a pesar del riesgo de que también pudiera cometer errores.

“Utiliza una IA para calificar a otra en un antiguo punto de referencia que se sabe que está lleno de errores, y no refleja lo que la gente realmente busca en Google”, dijo el portavoz. “Los conocimientos de IA se basan en nuestros modelos Gemini, que lideran la industria en precisión, y superan el mismo estándar de alta calidad que tenemos para todas nuestras funciones de búsqueda. »

Como informó The Post, AI Overviews ha luchado por proporcionar información precisa desde su lanzamiento, y anteriormente recomendaba a los usuarios que agregaran pegamento a la salsa de su pizza y promocionaba los “beneficios del tabaco para la salud” de los niños.