El Pentágono cortó lazos con Anthropic porque el uso de sus modelos de inteligencia artificial “contaminaría” la cadena de suministro del ejército estadounidense, dijo el jueves un alto funcionario del Departamento de Guerra.

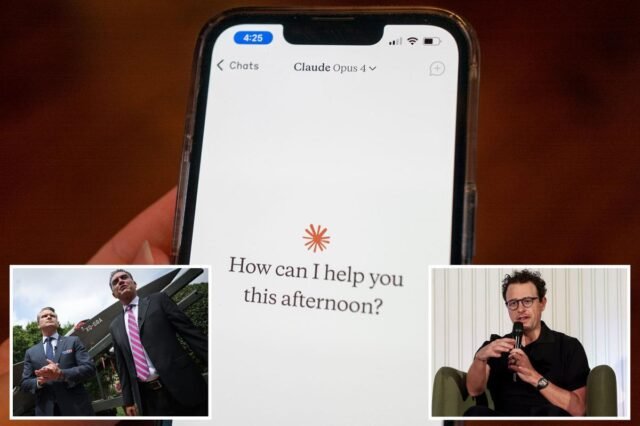

Emil Michael, director de tecnología del Departamento de Guerra, dijo que el chatbot Claude AI de Anthropic fue entrenado utilizando una ideología fundamentalmente diferente a la que el Pentágono quiere para sus sistemas.

“No podemos permitir que una empresa cuyas diferentes preferencias políticas están arraigadas en el modelo a través de su constitución, su alma, sus preferencias políticas, contamine la cadena de suministro y que nuestros combatientes obtengan armas ineficaces, chalecos antibalas ineficaces, protección ineficaz”, dijo Michael en una entrevista con CNBC.

“De ahí proviene realmente la designación de riesgo en la cadena de suministro”, añadió.

Anthropic actualmente está demandando al Pentágono después de convertirse en la primera empresa estadounidense en ser etiquetada oficialmente como “riesgo de la cadena de suministro”, una etiqueta normalmente reservada para entidades extranjeras que efectivamente obliga a los contratistas de defensa a dejar de usar su tecnología.

Michael dijo que la designación “no pretende ser punitiva” y negó las acusaciones de Anthropic de que la administración Trump dijo a empresas fuera del sector de defensa que no trabajaran con ellos.

Los funcionarios de Trump habían temido durante mucho tiempo que Anthropic tuviera inclinaciones ideológicas extravagantes, incluidos sus vínculos con el movimiento de culto “Altruismo Efectivo” y megadonantes demócratas como el cofundador de LinkedIn, Reid Hoffman.

A principios de este mes, The Post informó exclusivamente sobre extrañas publicaciones en el blog de Amanda Askell, la “filósofa” interna de Anthropic que ayudó a elaborar el “documento del alma” que gobierna a Claude.

La difícil relación de la administración Trump con Anthropic llegó a un punto crítico el mes pasado después de que la compañía y su director ejecutivo, Dario Amodei, se negaron a eliminar las salvaguardias que impedían que sus modelos de inteligencia artificial se utilizaran para impulsar armas autónomas o para la vigilancia masiva de estadounidenses.

El presidente Trump llamó a los ejecutivos de Anthropic “chiflados de izquierda” y ordenó a todas las agencias federales que dejaran de trabajar con la empresa. Concedió un período de transición de seis meses.

En ese momento, Claude de Anthropic era el único modelo aprobado para trabajar en los sistemas clasificados del Pentágono. Desde entonces, OpenAI ha firmado un acuerdo para hacerse cargo de la mayor parte de este trabajo.

Amodei, él mismo un donante demócrata, respondió arremetiendo contra Trump en un memorando interno, diciendo que el Pentágono apuntó a Anthropic porque no le dio al presidente “elogios al estilo dictador”. Posteriormente, el ejecutivo se disculpó.

La nueva demanda de Anthropic contra la administración Trump afirma que la designación de riesgo de la cadena de suministro y otras acciones del gobierno de Estados Unidos no tienen precedentes y son ilegales.

Mientras tanto, Palantir, otro contratista de defensa, todavía utiliza Claude por ahora, incluso para operaciones relacionadas con el conflicto con Irán, dijo su director ejecutivo. Alex Karp dijo a CNBC.