Por trân nguyễn | Prensa asociada

Sacramento – El gobernador de California, Gavin Newsom, firmó una ley el lunes que tiene como objetivo evitar que las personas usen Poderosos modelos de inteligencia artificial Para actividades potencialmente catastróficas, como la construcción de un arma biológica o el cierre de un sistema bancario.

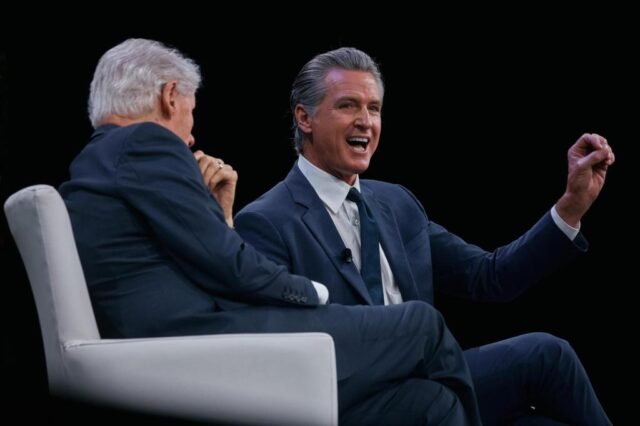

Esta decisión se produce cuando Newsom presentó a California como líder en la regulación de la IA y criticó la inacción a nivel federal durante una conversación reciente con el ex presidente Bill Clinton. La nueva ley establecerá algunas de las regulaciones de las Primeras Naciones sobre modelos de IA a gran escala sin dañar la industria estatal local, dijo Newsom. Muchas de las mejores empresas de IA del mundo se encuentran en California y tendrán que seguir los requisitos.

“California ha demostrado que podemos establecer regulaciones para proteger a nuestras comunidades al tiempo que garantizan que la creciente industria de IA continúe prosperando. Esta legislación establece este equilibrio”, dijo Newsom en un comunicado.

La legislación obliga a las empresas a implementar y revelar protocolos de seguridad pública para evitar que sus modelos más avanzados se utilicen para causar daños importantes. Las reglas están diseñadas para cubrir los sistemas AI si respetan un umbral de “borde” que señala que ejecutan en una gran cantidad de potencia de cálculo.

Estos umbrales se basan en el número de cálculos que realizan las computadoras. Aquellos que han desarrollado las regulaciones han reconocido que los umbrales digitales son un punto de partida imperfecto para distinguir los sistemas generativos más eficientes de hoy de la próxima generación que podría ser aún más poderosa. Los sistemas existentes son fabricados en gran medida por compañías basadas en California como Anthrope, Google, Meta Platforms y OpenAI.

La legislación define un riesgo catastrófico como algo que causaría al menos $ 1 mil millones en daños o más de 50 lesiones o muertes. Está diseñado para protegerse contra la IA utilizada para actividades que podrían causar perturbaciones de masa, como piratear una red eléctrica.

Las empresas también deben informar al estado cualquier incidente de seguridad crítico dentro de los 15 días. La ley crea protecciones de denuncia para los trabajadores de IA y establece una nube pública para los investigadores. Incluye una multa de $ 1 millón por violación.

Atrajo la oposición de ciertas compañías tecnológicas, que argumentó que la ley de IA debería llevarse a cabo a nivel federal. Pero Anthrope dijo que las regulaciones son “garantías prácticas” que oficialmente hacen prácticas de seguridad que muchas empresas son Ya voluntariamente.

“Si bien los estándares federales siguen siendo esenciales para evitar un mosaico de regulaciones estatales, California ha creado un marco sólido que equilibra la seguridad pública con innovación continua”, dijo Jack Clark, cofundador y jefe de política de Anthrope, en un comunicado.

La firma se produce después de que Newsom el año pasado se opuso a una versión más amplia de la legislación, moviéndose con compañías tecnológicas que declararon que los requisitos eran demasiado rígidos y habría obstaculizado la innovación. Newsom ha preguntado a un grupo de varios expertos de la industria, incluido el pionero Fei-Fei LiDesarrollar recomendaciones sobre barandilla en torno a potentes modelos de IA.

La nueva ley incorpora recomendaciones y comentarios del grupo de expertos en la industria de AI Newsom and Industry, dijeron los partidarios. La legislación tampoco pone el mismo nivel de requisitos de declaración en las nuevas empresas para evitar dañar la innovación, dijo el senador del estado de San Francisco de Scott Wiener, autor del proyecto de ley.

“Con esta ley, California se intensifica, una vez más, como líder mundial en innovación y seguridad tecnológicas”, dijo Wiener en un comunicado.

La decisión de Newsom se produce cuando el presidente Donald Trump anunció en julio un plan para eliminar lo que su administración considera regulaciones “costosas” para acelerar la innovación de IA y consolidar la posición de los Estados Unidos como líder mundial en IA. Los republicanos del Congreso a principios de este año han intentado sin éxito. Prohibir los estados y las localidades reguladoras de la IA por una década.

Sin regulaciones federales más fuertes, los estados de todo el país han pasado en los últimos años AI “Terapia”. En California, la Asamblea Legislativa ha adoptado un cierto número de proyectos de ley este año para responder a problemas de seguridad relacionados con los chatbots de IA para los niños y el uso de IA en el lugar de trabajo.

California también ha sido uno de los primeros en adoptar tecnologías de IA. Estado tiene Herramientas de IA generativas implementadas Para localizar incendios forestales y responder a la congestión de carreteras y seguridad vial, entre otros.

El periodista de Associated Press, Matt O’Brien, contribuyó al informe.