El director ejecutivo de Nvidia, Jensen Huang, dijo el lunes que la próxima generación de chips de la compañía está en “plena producción”, y dijo que pueden ofrecer cinco veces más inteligencia artificial que los chips anteriores de la compañía cuando sirven chatbots y otras aplicaciones de inteligencia artificial.

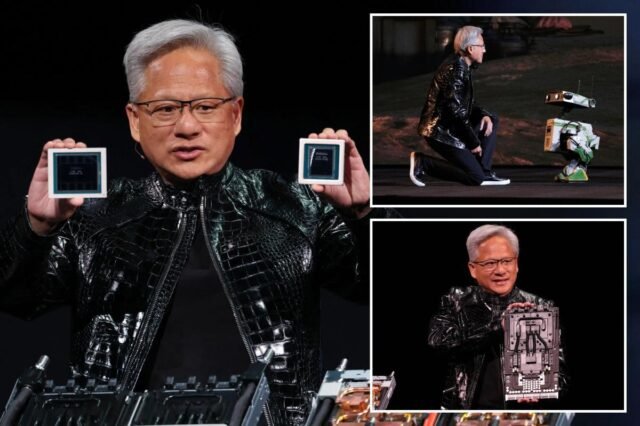

En un discurso en el Consumer Electronics Show en Las Vegas, el director de la compañía más valiosa del mundo reveló nuevos detalles sobre sus chips, que llegarán a finales de este año y que, según los ejecutivos de Nvidia, ya están siendo probados en los laboratorios de la compañía por empresas de inteligencia artificial, mientras Nvidia enfrenta una creciente competencia de sus rivales y de sus propios clientes.

Se espera que la plataforma Vera Rubin, compuesta por seis chips Nvidia distintos, debute a finales de este año, con el dispositivo insignia con 72 de las unidades gráficas emblemáticas de la compañía y 36 de sus nuevos procesadores centrales. Huang mostró cómo se pueden agrupar en “grupos” con más de 1.000 fichas Rubin.

Sin embargo, para lograr los nuevos resultados de rendimiento, Huang dijo que los chips Rubin utilizan un tipo de datos patentado que la compañía espera que toda la industria adopte.

“Así es como pudimos lograr un aumento de rendimiento tan gigantesco, a pesar de que sólo tenemos 1,6 veces más transistores”, dijo Huang.

Aunque Nvidia todavía domina el mercado de entrenamiento de modelos de IA, enfrenta una competencia mucho más dura (desde rivales tradicionales como Advanced Micro Devices hasta clientes como Google de Alphabet) para entregar los frutos de esos modelos a cientos de millones de usuarios de chatbots y otras tecnologías.

Gran parte del discurso de Huang se centró en la eficacia de los nuevos chips para esta tarea, incluida la adición de una nueva capa de tecnología de almacenamiento llamada “almacenamiento de memoria contextual” destinada a ayudar a los chatbots a proporcionar respuestas más rápidas a preguntas y conversaciones largas cuando los utilizan millones de usuarios a la vez.

Nvidia también presentó una nueva generación de conmutadores de red que presentan un nuevo tipo de conexión llamada óptica empaquetada. La tecnología, esencial para conectar miles de máquinas en una, compite con las ofertas de Broadcom y Cisco Systems.

En otros anuncios, Huang destacó un nuevo software que puede ayudar a los vehículos autónomos a tomar decisiones sobre qué camino tomar y dejar un rastro en papel que los ingenieros puedan utilizar más adelante. Nvidia presentó una investigación sobre un software llamado Alpamayo a finales del año pasado, y Huang dijo el lunes que se difundiría más ampliamente, junto con los datos utilizados para entrenarlo, de modo que los fabricantes de automóviles pudieran realizar evaluaciones.

“No sólo abrimos el código fuente de los modelos, sino que también abrimos el código fuente de los datos que utilizamos para entrenar esos modelos, porque sólo entonces puedes realmente tener confianza en cómo surgieron los modelos”, dijo Huang desde un escenario en Las Vegas.

El mes pasado, Nvidia adquirió talento y tecnología de chips de la startup Groq, incluidos ejecutivos que contribuyeron decisivamente a ayudar a Google de Alphabet a diseñar sus propios chips de inteligencia artificial. Aunque Google es un cliente importante de Nvidia, sus propios chips se han convertido en una de las mayores amenazas de Nvidia, ya que Google trabaja en estrecha colaboración con Meta Platforms y otros para atacar el bastión de inteligencia artificial de Nvidia.

Al mismo tiempo, Nvidia está ansiosa por demostrar que sus últimos productos pueden superar a los chips más antiguos como el H200, cuya importación el presidente Trump permitió a China. Reuters informó que el chip, que fue el predecesor del actual chip insignia de Nvidia, “Blackwell”, tiene una gran demanda en China, alarmando a los halcones chinos en todo el espectro político estadounidense.