Un tribunal federal de apelaciones en Washington, D.C., rechazó el miércoles la solicitud de Anthropic de bloquear temporalmente la inclusión de su tecnología de inteligencia artificial en la lista negra del Pentágono mientras se desarrolla en los tribunales su demanda contra el Departamento de Guerra.

La empresa de inteligencia artificial con sede en San Francisco está demandando al departamento por designarla como un riesgo para la cadena de suministro el mes pasado, alegando represalias después de que Anthropic intentara impedir que el gobierno utilizara su tecnología para vigilancia masiva y armamento.

“En nuestra opinión, el equilibrio equitativo se inclina a favor del gobierno”, dijo el tribunal de apelaciones en su fallo del miércoles.

“Por un lado, existe un riesgo relativamente contenido de daño financiero a una sola empresa privada. Por otro, está la gestión judicial de cómo y a través de quién el Departamento de Guerra asegura tecnología vital de IA durante un conflicto militar activo”.

En un fallo separado el mes pasado, un juez del tribunal federal de San Francisco concedió a Anthropic una orden judicial preliminar en su impugnación legal.

Después de los fallos judiciales divididos, Anthropic no puede trabajar con el Departamento de Guerra y otros contratistas de defensa tienen prohibido utilizar su chatbot Claude en su trabajo con el Pentágono.

Anthropic aún puede trabajar con otras agencias gubernamentales y los contratistas de defensa pueden usar Claude fuera de sus interacciones con el Pentágono.

En su fallo del miércoles, el tribunal de apelaciones dijo que la compañía “probablemente sufriría cierto grado de daño irreparable si no se suspendiera el proceso”, pero que sus preocupaciones “parecen principalmente de naturaleza financiera”.

A pesar del argumento de Anthropic de que la lista negra del Pentágono restringe su libertad de expresión, el tribunal escribió que “Anthropic no logra demostrar que su discurso fue congelado durante la tramitación de este litigio”.

Pero el tribunal también dijo que “se justifica una aceleración sustancial” en el caso debido al daño financiero que Anthropic enfrentará durante el litigio en curso.

“Estamos agradecidos de que el tribunal haya reconocido que estas cuestiones deben resolverse rápidamente y confiamos en que los tribunales finalmente aceptarán que estas designaciones de la cadena de suministro eran ilegales”, dijo un portavoz de Anthropic al Post en un comunicado.

“Si bien este caso es necesario para proteger a Anthropic, a nuestros clientes y a nuestros socios, nuestro objetivo sigue siendo trabajar productivamente con el gobierno para garantizar que todos los estadounidenses se beneficien de una IA segura y confiable”.

El fiscal general interino de Estados Unidos, Todd Blanche, describió la decisión del tribunal de apelaciones como una “victoria rotunda” en un artículo en X el miércoles por la noche.

“La autoridad militar y el control operativo residen en el Comandante en Jefe y el Departamento de Guerra, no en una empresa de tecnología”, escribió.

El Pentágono se negó a hacer comentarios.

Anthropic firmó un contrato de 200 millones de dólares con el Departamento de Guerra en julio, lo que lo convierte en el único proveedor de modelos de IA en las redes clasificadas del gobierno.

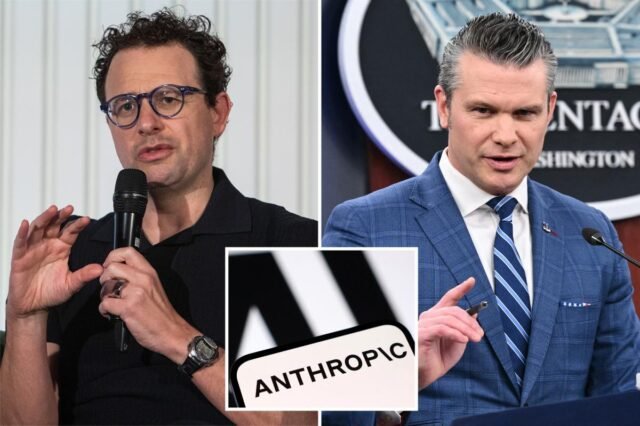

Pero las discusiones se agriaron durante las negociaciones del contrato cuando el secretario de Guerra, Pete Hegseth, criticó a la compañía por buscar exenciones sobre el uso de sus modelos para la vigilancia masiva de ciudadanos y armas, insistiendo en que el Pentágono debería tener carta blanca sobre las herramientas “para todos los fines legales”.

Hegseth le dio a Anthropic la etiqueta de riesgo de la cadena de suministro, una designación previamente reservada para empresas extranjeras que plantean amenazas a la seguridad nacional, como Huawei Technologies de China.

Si esta designación sigue vigente, requerirá que todos los contratistas de defensa demuestren que no están utilizando los modelos de IA de Anthropic en su trabajo con el ejército.

Las tensiones aumentaron después de que el mes pasado se filtrara al público una ardiente misiva de 1.600 palabras del director ejecutivo de Anthropic, Dario Amodei, criticando a la administración Trump. En él, el ejecutivo acusó al Pentágono de apuntar a su empresa por no dar “elogios al estilo dictatorial” a Trump.

Amodei se disculpó por el “tono” de su publicación, argumentando que sus comentarios se produjeron horas después de que el presidente Trump arremetiera contra el personal de Anthropic. “Trabajos para bichos raros de izquierda” Y Hegseth reveló sus planes. calificar a la empresa como un riesgo para la cadena de suministro.

Después de que el Pentágono incluyó efectivamente a Anthropic en la lista negra, OpenAI de Sam Altman llegó a un acuerdo para proporcionar servicios de inteligencia artificial al gobierno.

En su memorando filtrado, Amodei escribió que Anthropic estaba siendo castigada porque no “donó a Trump”, mientras que “OpenAI/Greg donó mucho”, refiriéndose al presidente de OpenAI, Greg Brockman. la información reportada.

Amodei, que hizo una donación para la fallida campaña presidencial de la exvicepresidenta demócrata Kamala Harris, también se burló de las “mentiras descaradas” de OpenAI y agregó que las garantías de la plataforma son “tal vez un 20% reales y un 80% de seguridad”.

En una conferencia de tecnología en marzo, Altman arremetió contra Amodei, diciendo que sería “malo para la sociedad” si las empresas comenzaran a abandonar su compromiso con el proceso democrático porque “a algunas personas no les agrada la persona o personas actualmente a cargo”.